编解码器被用于压缩视频,以减小传输视频流所需要的带宽,或者,降低把视频文件存档所需要的存储空间。这种压缩的代价就是增大计算要求:压缩比越高,对计算能力的要求就越高。

在带宽与计算要求之间做出折中,对于定义承载编码视频流所需要的最小信道带宽以及编码设备的最小指标均有影响。在传统的像广播电视机这样的视频系统中,解码器的最小规范(在机顶盒的情形下)易于被定义。

然而,目前视频被越来越多地由各种各样的应用所采用,相应地,有各种各样的客户设备,这些设备包括从计算机观看互联网视频,到便携式数字助理(PDA)以及小巧的蜂窝电话。针对这些设备的视频流必需是不同的。

为了更好地兼容特定的观看设备以及信道带宽,必须采用不同的设置对视频流多次编码。每一个设置的组合必须向用户产生一个满足视频流传输所需带宽的视频流以及对观看设备进行解码的能力。如果原始解压视频流不可用,那么,编码视频流必须首先被解码,然后采用新的设置进行解码。这种做法是十分昂贵的。

在理想的情形下,视频仅仅以高效率的编解码器被编码一次。如果经过解码的话,得到的视频流会产生全分辨率的视频。此外,在理想的情形下,如果较低分辨率或带宽的视频流需要被进一步延伸至网络之中,以锁定较低性能的设备,那么,可以不必采取附加的处理,就能够发送一小部分的编码视频。这种较小的视频流便于解码并产生较低分辨率的视频。以这种方式,编码视频流自身就能够适应它需要经过的信道带宽以及目标设备的性能。这些就是可扩展视频编解码器的品质所在。

H.264 可扩展视频编解码器

扩展至H.264的可扩展视频编解码器(H.264 SVC),被设计来传递上述理想情形的各种好处。它以H.264先进视频编解码器标准(H.264 AVC)为基础,并高度利用了原始编解码器的各种工具以及概念。然而,它产生的编码视频是空间上临时可扩展的,并且是在视频质量方面可扩展的。也就是说,它能够产生不同帧速率、分辨率或质量等级的解码视频。

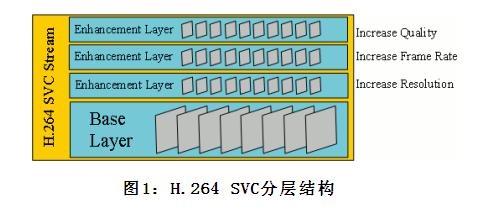

SVC扩展引入了一种原始H.264 AVC编解码器—在编码视频内的各层—不存在的概念。基础层对视频流的最低临时、空间和品质表现进行编码。增强各层利用基础层作为起点,对附加信息进行编码,从而在解码过程中把编码结果用于重构高质量、高分辨率或;临时的视频版本。

通过对基本层以及仅仅是所需要的后来增强层进行解码,解码器能够以所希望的特征产生一种视频流。图1所示为H.264 SVC流的分层结构。在编码的过程中,要利用仅仅对较低级各层的参考,小心地解码一个特殊层。以这种方式,编码流可以在任意点被删节,但是,仍然维持有效的、可解码的视频流。

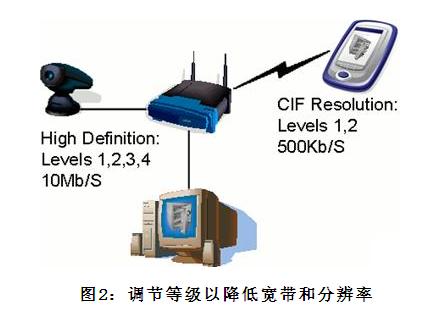

这种分层方法让所生成的一个编码流能够被删节以限制所消耗的带宽或者降低解码计算的要求。删节过程完全通过从编码视频流提取所需要的各层而构成。这个过程甚至能够在网络中执行。

也就是说,随着视频流从高带宽转换为较低带宽的网络(例如,通过WiFi链路从以太网转换至手持),要针对可用的带宽调节视频流的大小。在上述例子中,要针对无线链路的带宽调节视频流的大小以及手持解码器的解码能力。图2显示了个人电脑把低带宽的视频流转为为移动设备视频流的例子。

H.264 SVC揭秘

为了实现临时的可扩展性,H.264 SVC链接其参考帧以及预测帧,这与传统的H.264 AVC编码器稍微不同。SVC采用分层预测结构,如图3所示,而不是传统的内帧(I帧)、双向帧(B帧)以及预测帧(P帧)的关系。

分层结构定义最终视频流的临时分层。图4描述了可能的分层结构。在这个特殊的例子中,各帧仅仅根据上次出现的各帧进行预测。这就确保该结构不仅仅展示临时的可扩展性,而且显示了低的延迟。

这个方案具有四个嵌套的临时层:T0 (基础层)、T1、T2和T3。由T1和T2各层构成的帧仅仅由T0层中的各帧预测。在T3层中的各帧仅仅由T1或T2各层中的各帧来预测。

为了以3.75帧每秒的速度播放编码帧,仅仅构成T0的各帧需要被解码。所有的其它各帧可以被丢弃。为了以7.5fps的速度播放,要对构成T0以及T1的各层进行解码。在T2和T3中的各帧被丢弃。类似地,如果构成T0、T1和T2的各帧被解码,所得到的视频流将以15fps的速度播放。如果所有帧均被解码,那么,完全的30fps视频流被恢复。

相比之下,在H.264 SVC(对于Baseline Profile来说,仅仅双向预测帧被应用)中,不管需要的显示率是什么,所有帧均需被解码。为了转换至一个低带宽网络,整个视频流均需要被解码,不需要的帧可以被丢弃,然后,重新编码。

在H.264 SVC中的空间可扩展性遵循类似的原则。在这一情形下,较低分辨率的各帧被编码为基础帧。经解码和上行采样的基础帧被用于对较高阶各层进行预测。重构原始场景细节所需要的附加信息被编码为一个独立的增强层。在某些情形下,重用运动信息能够进一步增加编码效率。

同时联播与SVC

在H.264 SVC中存在于可扩展性相关的开销。正如我们在图3中所看到的那样,参考帧与预测帧之间的距离在时间(例如从T0至T1)上比传统的帧结构要长。在具有高运动图像的场景中,这能够导致效率稍低的压缩。为了对视频流各层级结构进行管理,也存在相关的开销。

整体而言,跟不具备可扩展性的全分辨率以及全帧速率视频构成的H.264视频流相比,具有三层临时可扩展性以及三层空间可扩展性的SVC视频可能要大20%以上。如果采用H.264 编解码器对可扩展性进行仿真,就需要多个编码视频流,从而导致更高的带宽要求或贯穿网络的昂贵解码和二次编码。

SVC的额外好处:

误码恢复

误码恢复的传统实现方法是把附加的信息添加至视频流之中,以便监测和校正误码。SVC的分层方法意味着不需要增加大的开销,就可以在较小的基本层上执行高级别的误码监测和校正。如果要把相同程度的误码监测和校正功能应用于AVC视频流中,那就需要把整个视频流保护起来,从而导致视频流更大。如果在SVC视频流中监测出误码,那么,就可以逐渐让分辨率和帧速率退化,直至—如果需要的话—只有高度受保护的基础层才可以使用。按照这一方式,在噪声条件下的退化要比在H.264 AVC环境下更让人可以接受。

存储管理

因为SVC视频流或文件即使在被删节的情况下仍然可被解码,SVC既可以在传输过程之中、也可以在文件被存储之后采用。把被分解的文件存储在光盘上并取消增强层,就可以在不对存储在文件中的视频流进一步处理的情况下,压缩文件的大小。这对于需要“要么全部管、要么不管”的方法进行光盘管理的AVC文件来说是不可能的。

内容管理

SVC视频流或文件固有[FS:Page]地包含较低分辨率以及帧速率的视频流。这些视频流可以被用于加速视频分析的应用或分类各种算法。临时可扩展性也使得视频流易于以快速进退的方式搜索。

H.264 SVC的典型应用是监控系统(Stretch公司在这个领域提供市场领先的解决方案,请访问其网站了解更多的细节)。以IP摄像机把视频馈入视频内容被存储的控制间的情况为例,在视频流上要运行基本运动监测分析。在控制间显示器上,以摄像机最大的分辨率(1280 x 720)观看馈入的视频,并以D1 (720 x 480)的分辨率存储在保存光盘空间上。第一反应团队也在现场反应车内的移动终端上接入视频流。那些显示器的分辨率是CIF (352 x 240),而视频流的伺服速率为7fps。

在利用H.264 AVC实现的过程中,首要约束可能就是该摄像机伺服多个视频流。在这个例子中,一个分辨率为1280x720,而另一个分辨率为720 x 480。在就给摄像机增加了额外的成本,但是,让视频流可以在控制间被直接记录,与此同时,另一个视频流被解码和显示。

如果没有这一功能,那就需要采用昂贵的解码、重定尺寸以及重新编码步骤。D1流也可以被解码并重新调节大小,以转换为CIF分辨率,从而馈入在视频流上运行的视频分析(工具)上。CIF分辨率在时间上骤减以实现每秒7帧以及重新编码,以便让第一反应车通过无线链路加以利用。图5显示了利用H.264 AVC可能实现的一个系统。

利用H.264 SVC编解码器,就可以放宽对摄像机伺服多个视频流的要求,降低系统复杂性,压缩摄像机与控制间之间的网络带宽。完整的1280 x 720视频流现在可以被存储在网络视频刻录机(NVR)上,这些文件可以被方便地分解,以创建D1(或CIF)视频流,从而在给定的时期之后把光盘空间腾空出来。CIF视频流可以直接由NVR伺服,以实现分析工作,而降低了帧速率的第二视频流可以被提供给第一反应车使用。图6显示了H.264 SVC的一种可能的实现方案。

因此,根本没有必要在视频流本身上进行操作,在业已存储的文件上进行操作就足够了。其优势是明显的:

压缩网络带宽;

具有灵活的存储管理;

取消了昂贵的解码以及二次编码的步骤;

如果需要的话,在NVR上的高清晰度视频可以用来归档;

本文小结

可扩展视频编解码器已经被开发了许多年。广播行业严格地受到业已建立的各种标准的控制,因此在采用这一技术上一直反应迟缓。处理器、传感器以及显示技术的进步正在点爆各种视频应用。互联网以及IP技术正无缝地把视频伺服至更为不同和远程的由显示设备构成的社群。可扩展视频编解码器如H.264 SVC满足了许多这些系统的需求,并且它们可能促使视频被广泛采纳为通信媒介的催化剂。

为您推荐

Chips&Media公司,领先的视频IP核供应商,今天宣布已经开始提供充分验证过的CODA960硬编解码器给其合作伙伴;CODA960编解码器具备多标准双路高清(1080p@60帧)视频处理能力。CODA960专为高性能实时视频处理设计,能够最有效管理内存,并提供卓越的抗系统延迟能力。Coda960核心的具有全高清(1080p)60帧每秒的解码能力,支持绝大多数视频格式的解码,比如MPEG1/2/4、H.264、MVC、VC-1、WMV9、RealVideo、AVS、H.263、Sorenson、MJPEG和VP8。同时也提供多标准全高清(1080p)30帧每秒的视频编码,包括的H.264、

多视点视频编解码器为Blu-rayDIScTM和其他数字媒体3D视频内容交付提供支持丹佛--(美国商业资讯)--一站式专利许可替代方案的全球领先企业MPEGLA,LLC宣布征集用于交付3D视频图像的多视点视频编解码器(MVC)标准的必要专利。多视点视频编解码器用于在Blu-rayDiSCTM设备和光盘上存储和播放3D视频内容(参见http://www.businesswire.co

Google继表示Chrome不再支持HTML5标准之后,又有动作。近日开声苛责H.264视频编解码技术,指责其通过抑制创新损害网络视频的长期健康发展。在Google产品经理MikeJazayeri的一篇博文中,他长篇大论地解释了Google为什么要放弃对HTML5的支持,转而使用不太受欢迎的WebM标准。同时,他重复强调Google认为H.264将永远不会成为HTML视频标准的基线,因为它对版权许可的要求过于严格。他说,“进一步讲,我们确实认为核心的网络技术需要是开放性的,大家可以通过相关的开发进行技术创新。这是我们联合网络社区共同努力且转而使用WebM的主要原因,因为它相对来说更为开放。”

该授权协议包括紧凑型4KEcTMPro内核、高性能24KTMPro系列、多线程34KTMPro系列、超标量74KTM系列、1004K一致处理系统(CoherentProcessingSystem,CPS)系列、新款超标量多内核1074KCPS系列及MIPSSOC-itL2高速缓存控制器等MIPS32内核。瑞昱半导体执行副总裁陈进兴(JessyChen)表示:“我们采用MIPS内核开发用于无线网关、交换机和路由器等多项产品的SoC,以及针对数字家庭和多媒体应用的新型解决方案,都已获得了极大的成功。为了开发更多样化的新一代解决方案,我们正与MIPS科技紧密合作,以确保能实现Android、Linu